1. Kafka ACK應答機制:消息可靠傳遞的基礎

Kafka通過生產者配置參數acks來控制消息持久化的可靠性級別,這是保證消息不丟失的第一道防線。

1.1 ACK的三種模式

- acks=0:生產者發送消息后立即認為成功,不等待任何確認。性能最高,但可能出現數據丟失。

- acks=1:生產者等待Leader副本寫入成功即返回確認。這是默認配置,在Leader故障且副本未同步時可能丟失數據。

- acks=all/-1:生產者等待ISR(In-Sync Replicas)中所有副本都寫入成功才返回確認。這是最安全的模式,但延遲最高。

1.2 配置優化建議

`properties

# 生產者配置

delivery.timeout.ms=120000 # 發送超時時間

request.timeout.ms=30000 # 請求超時時間

retries=5 # 重試次數

retry.backoff.ms=100 # 重試間隔`

2. 數據重復問題:根源與挑戰

當生產者收到Broker的確認超時或失敗時,重試機制可能導致消息重復發送。在分布式系統中,網絡分區、節點故障等場景都可能引發"至少一次"語義下的數據重復。

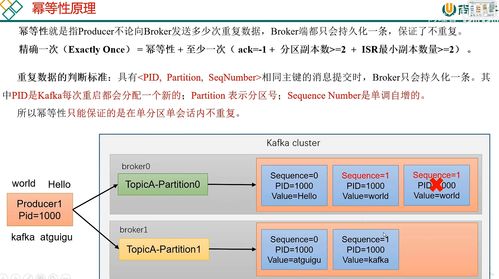

3. 冪等性原理:解決生產者端數據重復

3.1 實現機制

Kafka 0.11+版本引入了生產者冪等性,通過三個關鍵組件保證單分區內消息不重復:

- Producer ID(PID):每個生產者實例的唯一標識

- Sequence Number(序列號):每個分區內的消息序號

- Epoch(紀元號):防止PID被重復使用

3.2 工作原理

`java

// 啟用冪等生產者

Properties props = new Properties();

props.put("enable.idempotence", true);

props.put("acks", "all");

props.put("retries", Integer.MAX_VALUE);

props.put("max.in.flight.requests.per.connection", 5);

// Broker端會檢查:

// 1. 同一PID + Partition + Sequence Number的消息

// 2. 序列號連續遞增

// 3. 拒絕重復或亂序的消息`

3.3 局限性

- 只能保證單生產者會話內的冪等性

- 只能保證單分區內的冪等性

- Producer重啟后PID會變化,無法跨會話保證冪等

4. 事務處理:跨分區與跨會話的可靠性保證

4.1 事務核心概念

- 事務協調器:Broker中的特殊組件,管理事務狀態

- 事務日志:

<em>_transaction</em>state主題,持久化事務元數據 - 兩階段提交:準備階段 + 提交/中止階段

4.2 事務工作流程

`java

// 生產者事務配置

Properties props = new Properties();

props.put("transactional.id", "my-transactional-id");

props.put("enable.idempotence", true);

// 事務使用示例

KafkaProducer producer = new KafkaProducer(props);

producer.initTransactions();

try {

producer.beginTransaction();

producer.send(new ProducerRecord("topic1", "key1", "value1"));

producer.send(new ProducerRecord("topic2", "key2", "value2"));

producer.commitTransaction();

} catch (Exception e) {

producer.abortTransaction();

throw e;

}`

4.3 事務隔離級別

- read_uncommitted(默認):消費者可以看到未提交的消息

- read_committed:消費者只能看到已提交的消息

5. 在線數據處理與交易處理業務的實踐方案

5.1 電商訂單場景的完整解決方案

// 訂單處理系統的Kafka配置

public class OrderProcessingSystem {

// 生產者配置:保證訂單消息的可靠性

private Properties getProducerConfig() {

Properties props = new Properties();

props.put("bootstrap.servers", "kafka1:9092,kafka2:9092");

props.put("transactional.id", "order-producer");

props.put("enable.idempotence", true);

props.put("acks", "all");

props.put("max.in.flight.requests.per.connection", 5);

props.put("retries", 10);

return props;

}

// 處理訂單的分布式事務

public void processOrder(Order order) {

try (KafkaProducer producer = new KafkaProducer(getProducerConfig())) {

producer.initTransactions();

producer.beginTransaction();

// 1. 發送訂單創建消息

producer.send(new ProducerRecord("orders", order.getId(), order));

// 2. 扣減庫存

producer.send(new ProducerRecord("inventory", order.getProductId(),

new InventoryUpdate(order.getProductId(), -order.getQuantity())));

// 3. 生成支付記錄

producer.send(new ProducerRecord("payments", order.getId(),

new Payment(order.getId(), order.getAmount())));

producer.commitTransaction();

} catch (Exception e) {

// 事務回滾,所有消息都不會被消費

logger.error("訂單處理失敗,事務已回滾", e);

throw new OrderProcessingException(e);

}

}

}5.2 消費者端的去重策略

即使生產者保證了精確一次,消費者仍需要自己的去重機制:

// 基于數據庫的唯一約束去重

public class DeduplicationConsumer {

@KafkaListener(topics = "orders")

@Transactional

public void consume(Order order) {

// 1. 檢查消息是否已處理

if (orderRepository.existsById(order.getId())) {

return; // 已處理,直接返回

}

// 2. 保存訂單(數據庫唯一約束會防止重復)

orderRepository.save(order);

// 3. 執行業務邏輯

inventoryService.deductStock(order);

paymentService.createPayment(order);

}

}5.3 監控與運維建議

- 監控指標:

- 事務提交/中止率

- 消息重復率

- 端到端延遲

- 生產者重試次數

- 災難恢復:

- 定期備份

<em>_transaction</em>state主題

- 設置合理的transaction.timeout.ms(默認1分鐘)

- 監控事務協調器的負載

6. 性能與可靠性的平衡

6.1 不同場景的配置建議

| 場景 | ACK配置 | 冪等性 | 事務 | 性能影響 |

|------|---------|--------|------|----------|

| 日志收集 | acks=1 | 關閉 | 關閉 | 低 |

| 指標監控 | acks=1 | 開啟 | 關閉 | 中低 |

| 訂單交易 | acks=all | 開啟 | 開啟 | 中高 |

| 金融支付 | acks=all | 開啟 | 開啟 + 消費者去重 | 高 |

6.2 最佳實踐

- 分層保障:ACK機制 → 冪等性 → 事務 → 業務層去重

- 合理超時:根據業務容忍度設置delivery.timeout.ms

- 監控告警:建立完整的監控體系

- 測試驗證:模擬網絡分區、節點故障等異常場景

7. 結論

Kafka通過多層次的可靠性機制,為在線數據處理與交易處理業務提供了完整的解決方案。從基礎的ACK應答,到生產者冪等性,再到分布式事務,每個層級都在性能與可靠性之間提供了不同的權衡點。在實際業務中,需要根據具體的業務需求、數據一致性要求和性能指標,選擇合適的配置組合,構建既可靠又高效的數據處理管道。

對于關鍵業務系統,建議采用"事務 + 業務去重"的雙重保障策略,在享受Kafka高性能的確保數據的精確一次處理,滿足在線交易系統對數據一致性的嚴格要求。